Μια νέα και ισχυρή απειλή κερδίζει ολοένα και περισσότερο έδαφος στο χώρο του διαδικτύου αλλά η ΕΛ.ΑΣ. βρίσκεται ένα βήμα μπροστά.

Ο λόγος για τα “deep fake video” που χρησιμοποιούνται από απατεώνες με σκοπό, μεταξύ άλλων, την οικονομική απάτη.

Ρεπορτάζ: Θεοδώρα Απότα

Συγκεκριμένα, με τη χρήση των νευρωνικών δικτύων (neural networks) και της βαθιάς μάθησης (deep learning) οι ψηφιακοί εγκληματίες μπορούν να βασιστούν σε φωτογραφίες αλλά και σε οπτικοακουστικό υλικό ώστε να δημιουργήσουν ρεαλιστικά βίντεο ενός ανυποψίαστου ατόμου. Η τεχνητή νοημοσύνη «μαθαίνει» τα χαρακτηριστικά ενός προσώπου και αντικαθιστά το πρόσωπο ενός ανθρώπου με αυτό ενός άλλου ενώ μπορεί να αναπροσαρμόσει ακόμα και τη φωνή του. Όσο περισσότερο υλικό διαθέτει, τόσο πιο αληθοφανές είναι το αποτέλεσμα.

Σύμφωνα με αστυνομικές πηγές, η γνωστή τηλεφωνική απάτη με τα δήθεν τροχαία ατυχήματα δεν αποκλείεται να μεταπηδήσει στο χώρο του διαδικτύου με τη μορφή βίντεο. Για παράδειγμα: Χρήστης του διαδικτύου δέχεται μήνυμα – βίντεο από συγγενικό του πρόσωπο που του ζητά χρήματα για δήθεν επείγουσα ανάγκη. Το βίντεο είναι ψευδές, πλην όμως πειστικό και η ΕΛ.ΑΣ. το γνωρίζει.

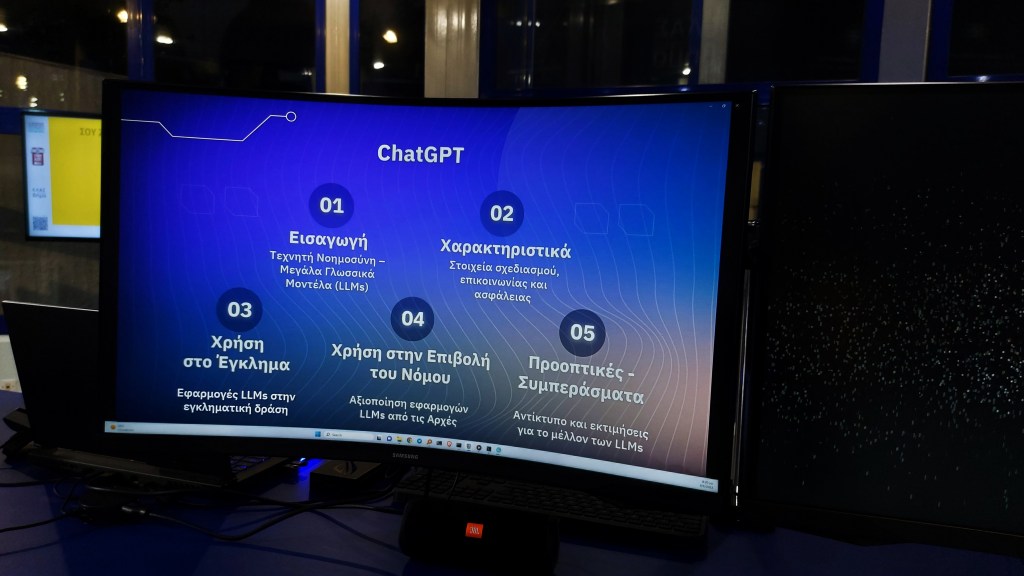

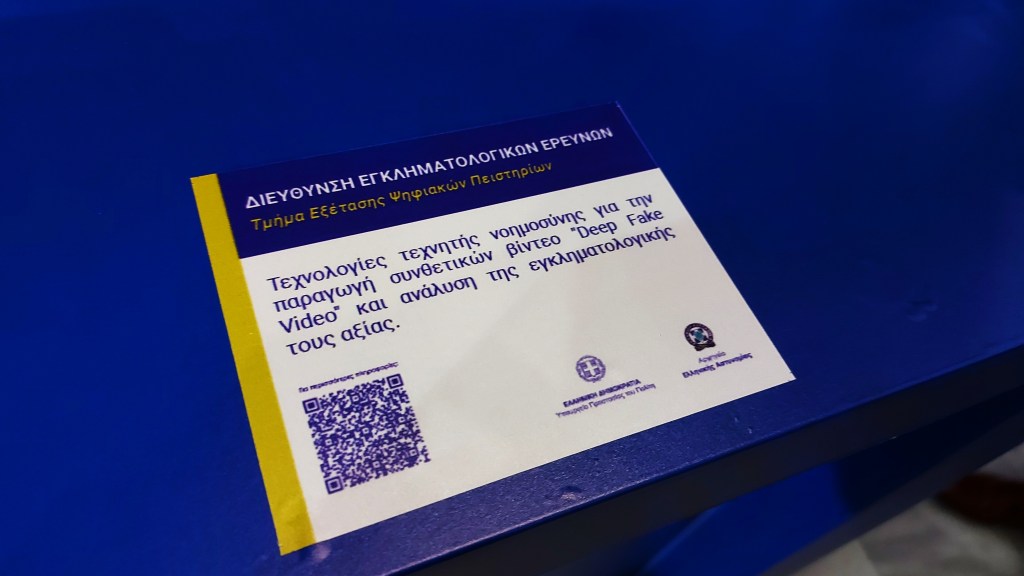

Το Τμήμα Εξέτασης Ψηφιακών Πειστηρίων της Διεύθυνσης Εγκληματολογικών Ερευνών ερευνά την τεχνολογία deepfake και τις χρήσεις της σε διεθνές επίπεδο ενώ αξιοποιεί την τεχνητή νοημοσύνη ώστε να αντιμετωπίσει την «κακή» της πλευρά με το ίδιο νόμισμα.

Παράλληλα, η χρήση εργαλείων AI βοηθά την Αστυνομία στην απλοποίηση χρονοβόρων διαδικασιών όπως ο εντοπισμός συγκεκριμένου υλικού σε μια μεγάλη βάση δεδομένων αλλά και στην εύρεση κωδικών κακόβουλων χρηστών του διαδικτύου.